Apple soulève des problèmes de confidentialité avec ses appareils.

Andrew Hoyle/CNET

Apple s'est longtemps présenté comme un

bastion de la sécurité

, et comme l'une des seules entreprises technologiques qui

se soucie vraiment de la confidentialité des utilisateurs

. Mais une nouvelle technologie conçue pour aider un ordinateur iPhone, iPad ou Mac

détecter les images et vidéos d'exploitation d'enfants

stockées sur ces appareils a déclenché un débat acharné sur la vérité derrière les promesses d'Apple.

Le 5 août, Apple a annoncé une nouvelle fonctionnalité intégrée dans le prochain

iOS 15, iPad OS 15

, WatchOS 8 et

MacOS Monterey

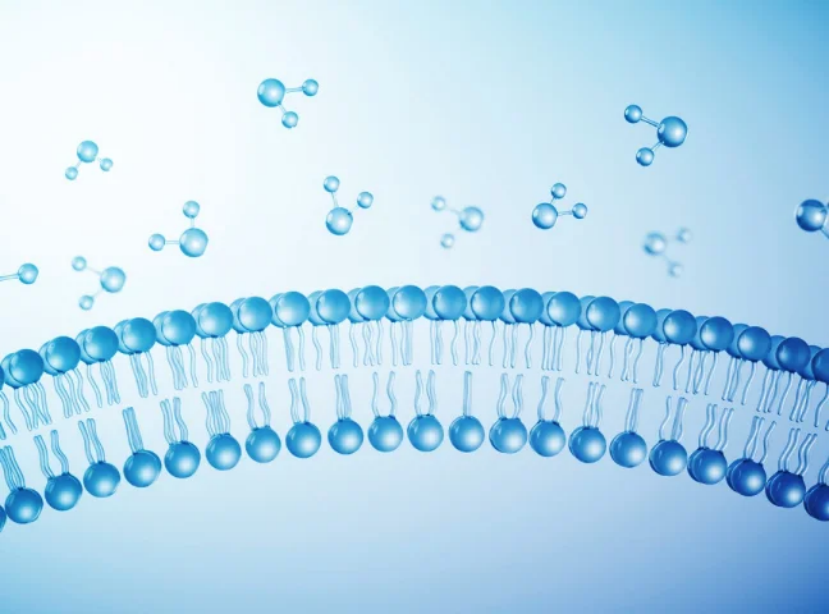

mises à jour logicielles conçues pour détecter si quelqu'un a des images ou des vidéos d'exploitation d'enfants stockées sur son appareil. Pour ce faire, il convertit les images en bits de code uniques, appelés hachages, en fonction de ce qu'ils représentent. Les hachages sont ensuite vérifiés par rapport à une base de données de contenu connu d'exploitation d'enfants qui est gérée par le

Centre national pour les enfants disparus et exploités

. Si un certain nombre de correspondances sont trouvées, Apple est alors alerté et peut poursuivre l'enquête.

Apple a déclaré avoir développé ce système pour protéger la vie privée des personnes, en effectuant des analyses sur le téléphone et en ne déclenchant des alarmes que si un certain nombre de correspondances sont trouvées. Mais les experts en protection de la vie privée, qui conviennent que lutter contre l'exploitation des enfants est une bonne chose, craignent que les mesures d'Apple n'ouvrent la porte à des utilisations plus larges qui pourraient, par exemple, mettre en danger des dissidents politiques et d'autres personnes innocentes.

"Même si vous pensez qu'Apple ne permettra pas que ces outils soient mal utilisés, il y a encore beaucoup à craindre", a tweeté Matthew Green, professeur à l'Université Johns Hopkins qui a travaillé sur les technologies cryptographiques.

La nouvelle fonctionnalité d'Apple et les inquiétudes qui en découlent représentent un débat important sur l'engagement de l'entreprise en matière de confidentialité. Apple promet depuis longtemps que ses appareils et logiciels sont conçus pour protéger la vie privée de leurs utilisateurs. La société a même dramatisé cela avec

une annonce accrochée juste à l'extérieur de la salle des congrès

du Consumer Electronics Show 2019, qui disait "Ce qui se passe sur votre iPhone reste sur votre iPhone."

" Chez Apple, nous pensons que la confidentialité est un droit humain fondamental ", Tim Cook, PDG d'Apple

a souvent dit

.

Rapport Apple CNET

Restez à jour sur les dernières nouvelles, critiques et conseils sur les iPhones, iPads, Macs, services et logiciels.

La technologie de numérisation d'Apple fait partie d'un trio de nouvelles fonctionnalités que la société prévoit pour cet automne. Apple permet également à son assistant vocal Siri d'offrir des liens et des ressources aux personnes qui, selon lui, pourraient se trouver dans une situation grave, comme un enfant en danger. Les avocats réclamaient ce type de fonctionnalité depuis un certain temps.

Il ajoute également une fonctionnalité à son application de messagerie pour protéger de manière proactive les enfants contre le contenu explicite, qu'il s'agisse d'une conversation SMS à bulle verte ou d'un chat crypté iMessage à bulle bleue. Cette nouvelle fonctionnalité est spécialement conçue pour les appareils enregistrés sous le compte iCloud d'un enfant et avertira s'il détecte une image explicite envoyée ou reçue. Comme avec Siri, l'application proposera également des liens et des ressources si nécessaire.

Le système d'Apple alertera également les enfants des images explicites envoyées ou reçues sur son application de messagerie.

Pomme

Il y a beaucoup de nuances ici, ce qui explique en partie pourquoi Apple

a pris la décision inhabituelle de publier des articles de recherche

, des questions fréquemment posées et d'autres informations avant le lancement prévu.

Voici tout ce que vous devez savoir :

Pourquoi Apple fait-il cela maintenant ?

Agrandir l'image

La fonction de synchronisation de la bibliothèque de photos iCloud d'Apple synchronise les images et les vidéos entre les appareils d'une personne et les serveurs de l'entreprise.

Pomme

Le géant de la technologie a déclaré qu'il essayait de trouver un moyen d'aider à mettre fin à l'exploitation des enfants depuis un certain temps. Le Centre national pour les enfants disparus et exploités a reçu plus de 65 millions de rapports de matériel l'année dernière. Apple a déclaré que c'était loin des 401 rapports d'il y a 20 ans.

"Nous savons également que les 65 millions de fichiers qui ont été signalés ne représentent qu'une petite fraction de ce qui est en circulation", a déclaré

Julie Cordua, chef d'Épine

, une organisation à but non lucratif luttant contre l'exploitation des enfants qui soutient les efforts d'Apple. Elle a ajouté que la loi américaine oblige les entreprises technologiques à signaler le matériel d'exploitation s'ils le trouvent, mais qu'elle ne les oblige pas à le rechercher.

D'autres entreprises recherchent activement de telles photos et vidéos. Facebook, Microsoft, Twitter et Google (et sa filiale YouTube) utilisent tous diverses technologies pour analyser leurs systèmes à la recherche de téléchargements potentiellement illégaux.

Ce qui rend le système d'Apple unique, c'est qu'il est conçu pour analyser nos appareils, plutôt que les informations stockées sur les serveurs de l'entreprise.

Le système de numérisation de hachage ne sera appliqué qu'aux photos stockées dans la bibliothèque de photos iCloud, qui est un système de synchronisation de photos intégré aux appareils Apple. Il ne hachera pas les images et les vidéos stockées dans l'application Photos d'un téléphone, d'une tablette ou d'un ordinateur qui n'utilise pas la bibliothèque de photos iCloud. Ainsi, d'une certaine manière, les gens peuvent se retirer s'ils choisissent de ne pas utiliser les services de synchronisation de photos iCloud d'Apple.

Ce système peut-il être abusé ?

La Chine censure agressivement les discours et les images politiques.

Getty Images

La question qui se pose n'est pas de savoir si Apple doit faire ce qu'il peut pour lutter contre l'exploitation des enfants. Il s'agit de savoir si Apple doit utiliser cette méthode.

La question de la pente glissante que les experts en matière de protection de la vie privée ont soulevée est de savoir si les outils d'Apple pourraient être transformés en technologie de surveillance contre les dissidents. Imaginez si le gouvernement chinois était capable d'ajouter secrètement des données correspondant aux

photo de Tank Man célèbre supprimée

des manifestations pro-démocratie de 1989 sur la place Tiananmen au système de contenu d'Apple sur l'exploitation des enfants.

Apple a déclaré avoir conçu des fonctionnalités pour empêcher que cela ne se produise. Le système ne numérise pas les photos, par exemple, il vérifie les correspondances entre les codes de hachage. La base de données de hachage est également stockée sur le téléphone, pas une base de données sur Internet. Apple a également noté qu'étant donné que les analyses ont lieu sur l'appareil, les chercheurs en sécurité peuvent vérifier plus facilement son fonctionnement.

Apple fouille-t-il dans mes photos ?

Nous en avons tous vu une version : la photo du bébé dans la baignoire. Mes parents avaient certains de moi, j'ai certains de mes enfants, et c'était même un gag courant dans la comédie animée Dreamworks 2017

Le patron bébé

.

Apple dit que ces images ne devraient pas faire trébucher son système. Étant donné que le système d'Apple convertit nos photos en ces codes de hachage, puis les compare à une base de données connue de vidéos et de photos d'exploitation d'enfants, la société n'analyse pas réellement nos affaires. La société a déclaré que la probabilité d'un faux positif est inférieure à un sur mille milliards par an.

"De plus, chaque fois qu'un compte est signalé par le système, Apple procède à un examen humain avant de faire un rapport au National Center for Missing and Exploited Children", a écrit Apple sur son site. "En conséquence, les erreurs système ou les attaques n'entraîneront pas le signalement d'innocents au NCMEC."

Apple lit-il mes textes ?

Apple n'applique pas sa technologie de hachage à nos messages texte. Il s'agit en fait d'un système distinct. Au lieu de cela, avec des messages texte, Apple n'alerte qu'un utilisateur marqué comme enfant dans son compte iCloud du moment où il est sur le point d'envoyer ou de recevoir une image explicite. L'enfant peut toujours voir l'image, et s'il le fait, un parent sera alerté.

"La fonctionnalité est conçue pour qu'Apple n'ait pas accès aux messages", a déclaré Apple.

Que dit Apple ?

Apple maintient que son système est conçu dans un souci de confidentialité, avec des garanties pour empêcher Apple de connaître le contenu de nos bibliothèques de photos et pour minimiser le risque d'utilisation abusive.

"Chez Apple, notre objectif est de créer une technologie qui responsabilise les gens et enrichit leur vie, tout en les aidant à rester en sécurité", a déclaré Apple dans un communiqué. « Nous voulons protéger les enfants des prédateurs qui utilisent des outils de communication pour les recruter et les exploiter, et limiter la propagation du matériel d'abus sexuel d'enfants. »