La réaction contre la technologie a commencé dans les livres. Dans les années 2010, lorsque la devise de Google "Ne sois pas méchant" semblait peu ironique et que les conférences TED louant Internet comme le grand égaliseur social attiraient encore un public crédule, des livres tels que "The Filter Bubble" d'Eli Pariser et "The Age of Surveillance" de Shoshana Zuboff Capitalisme » étaient des termes définissant qui modifieraient massivement l'opinion publique. Au cours de la prochaine décennie, la technologie, ou plus précisément les logiciels, allait être considérée moins comme une commodité innovante que comme un signe avant-coureur de bouleversements sociétaux.

En 2022, l'anti-technologie est courante. Des idées issues de livres sur la façon dont les plates-formes et leurs algorithmes d'intelligence artificielle sous-jacents menacent la société ont fait leur chemin dans les documentaires Netflix, les éditoriaux, la législation bipartite et même le dernier "Space Jam" (avec le supervillain Al-G Rhythm, joué par Don Cheadle). Des spécialistes de la technologie tels que Lina Khan et Meredith Whittaker, autrefois considérés comme marginaux pour leurs critiques des dommages structurels de la technologie, se sont retrouvés avec des nominations importantes dans l'administration Biden. Le monde écoute enfin les critiques de la technologie. Alors maintenant, la question est : sur quoi devraient-ils écrire ensuite ?

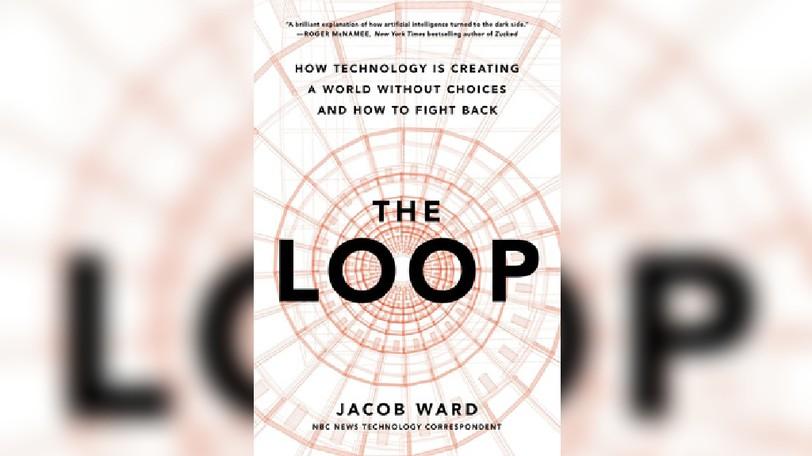

La réponse facile est de surfer sur la vague de la nouvelle impopularité de la technologie, et c'est l'option que Jacob Ward, correspondant technique de NBC News, a choisie par écrit "La boucle : comment la technologie crée un monde sans choix et comment pour riposter. Le livre soutient que les technologies d'IA capitalistes "s'attaquent à nos fragilités psychologiques" et menacent de créer "un monde dans lequel nos choix sont restreints, l'action humaine est limitée et nos pires impulsions inconscientes dominent la société". Plus que de dire aux lecteurs quelque chose de nouveau sur les dangers de la technologie, "The Loop" fournit la preuve que la critique technologique elle-même se calcifie en un genre grand public.

La "boucle" titulaire dont Ward met en garde ses lecteurs est enracinée dans le pouvoir, la prévisibilité et la stupidité de nos esprits inconscients. Lorsque les humains prennent des décisions, notre cerveau prend rapidement des raccourcis. Ce faisant, nous commettons des erreurs prévisibles et systématiques telles qu'une erreur de calcul des risques et une confiance excessive en l'autorité. Les entreprises technologiques, selon Ward, utilisent des algorithmes pour détourner ces schémas inconscients à des fins lucratives. La « boucle » est la spéculation de Ward selon laquelle notre dépendance croissante aux produits d'IA - Spotify pour les recommandations musicales, les algorithmes de médias sociaux pour les nouvelles, les armes automatisées pour faire la guerre - conduit notre inconscience, qui à son tour nous rend plus dépendants de l'IA, et ainsi de suite. sur. "Dans une génération ou deux", postule Ward, "nous serons une espèce entièrement différente - distraite, obéissante, impuissante à résister aux technologies que nous utilisons pour faire nos choix à notre place, même quand ce sont les mauvais choix."

Tout au long du livre, Ward interroge des technologues, des universitaires et des utilisateurs quotidiens pour comprendre comment différents produits d'IA sont devenus inextricablement liés à la vie des gens. Dans une section, il s'entretient avec des personnes accros aux "jeux de casino sociaux", des simulateurs de jeu gratuits qui incitent les utilisateurs, souvent pauvres et dans des endroits sombres de leur vie, à dépenser des dizaines de milliers de dollars réels en monnaie du jeu. . Dans un autre, Ward chevauche avec des policiers alors qu'ils patrouillent sur un rythme dicté par PredPol (maintenant Geolitica), un algorithme tristement raciste qui prédit où le crime se produira en fonction d'incidents passés. Ward demande : « Que se passe-t-il lorsque les budgets et les calendriers des services de police sont construits sur l'hypothèse qu'un abonnement à un logiciel peut remplacer le besoin de payer des heures supplémentaires pour les détectives ? Pour les particuliers comme pour les institutions, une fois l'IA introduite, il est difficile de la supprimer.

Plus souvent qu'autrement, cependant, les exemples de Ward ne correspondent pas à sa conception soignée de l'IA en tant que force du mal. Prenez sa discussion sur l'incident de 2017 à bord du vol 3411 de United Airlines lorsque des agents de sécurité ont physiquement traîné David Dao, un médecin, hors d'un avion en surréservation ; il avait refusé de partir après avoir été sélectionné plus ou moins au hasard pour un retrait involontaire. Ward décrit Dao non pas comme une victime d'un service client violemment mauvais, mais comme un combattant de la liberté éclairé qui s'est opposé à un algorithme dictatorial. "Tout le monde - des agents de bord qui ont insisté pour que Dao change de vol malgré les conséquences pour ses patients, au jeune couple qui est descendu lorsqu'on lui a demandé, aux officiers appelés à retirer Dao - a agi sous la direction d'une machine plus grande et mystérieuse." Ward aurait pu utiliser l'incident de United pour aborder des questions difficiles sur le moment où les algorithmes devraient être utilisés pour prendre des décisions et comment ces décisions devraient être communiquées. Au lieu de cela, il l'utilise comme une autre occasion de serrer le poing contre un ordinateur qui a tout gâché.

Évitez avec la même vigueur l'IA qui améliore manifestement la vie des gens. Il interviewe Yacqueline, une femme divorcée qui a du mal à gérer l'hostilité envers son ex alors qu'ils négocient du temps avec leur fils de 5 ans. Un juge ordonne qu'elle et son ex-mari communiquent via coParenter, une application de messagerie pour les parents divorcés qui utilise l'IA pour détecter et atténuer le langage hostile. Yacqueline décrit l'application comme une aubaine, mais Ward n'y voit que du danger. «Yacqueline et son ex modélisent-ils quoi que ce soit pour [their son], à l'exception de la collégialité fade qu'ils lisent ligne par ligne à partir d'une série d'invites pilotées par l'IA? . . . Est-ce une formation ? Ou sont ces roues d'entraînement qui ne se détachent jamais ? » Ward ignore toute preuve du contraire, telle que la façon dont Yacqueline n'a jamais appris de telles compétences de gestion des conflits de ses propres parents divorcés sans IA.

"The Loop" a les bonnes anecdotes pour lutter contre l'ambiguïté éthique de l'IA, mais au lieu de cela, il essaie de prouver que l'IA est, presque sans exception, mauvaise. Ward semble avoir tiré les mauvaises leçons des auteurs de techlash qui l'ont précédé : plutôt que de suivre leurs méthodes de considération sous tous les angles et de remettre en question le statu quo, il chevauche le nouveau statu quo qu'ils ont contribué à établir.

Aujourd'hui, le défi de critiquer le capitalisme et la technologie basés sur l'IA au sens large est qu'il est difficile de trouver un argument selon lequel les lecteurs dont les cerveaux ont été suffisamment déformés par Internet ne pourraient pas s'imaginer eux-mêmes . Certains livres récents ont relevé le défi – «Atlas of AI» de Kate Crawford et la récente série de quatre livres de Logic Magazine sur l'industrie technologique, par exemple, jettent un nouvel éclairage sur l'impact environnemental de l'IA et les pratiques de travail louches. Mais "The Loop", comme de nombreux livres qui visent à prouver que la technologie est sans équivoque mauvaise, a peu de nouveautés à offrir. Au lieu de cela, il continue de sonner la cloche de l'agitation anti-technologique, un son que nous avons tous entendu auparavant et que nous n'avons pas besoin d'entendre à nouveau.

Gabriel Nicholas est chercheur au Center for Democracy & ; Technology et co-boursier au NYU Information Law Institute et au NYU Center for Cybersecurity.

La boucle

Comment la technologie crée un monde sans choix et comment riposter

Par Jacob Ward

Hachette. 320 pages. 29 $